知识读取与逻辑推理分离:上海AI实验室DRIFT框架重塑长上下文处理。

近年来,大语言模型在处理长文本时的表现备受关注。随着上下文窗口逐步扩展至极大规模,研究者开始质疑单纯延长输入长度是否真正提升推理质量。上海人工智能实验室团队提出一种创新方法,将知识获取过程与推理过程明确分离,从而优化整体效率与准确性。

传统方式中,模型往往同时承担读取海量信息和执行复杂逻辑的任务。这种耦合导致在超长文档面前,计算资源消耗剧增,同时关键细节容易被噪声淹没。研究团队认为,复杂推理需要强大模型的支持,但从庞大文本中提取相关知识并不一定依赖同一架构。小型模型更适合高效扫描与提炼,而大型模型则擅长深度思考。这种分工思路为长上下文推理开辟新路径。

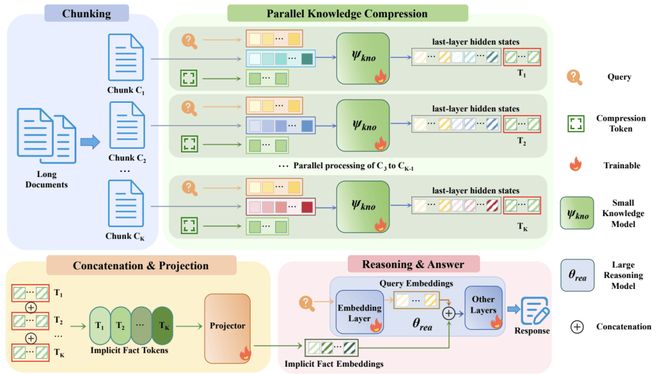

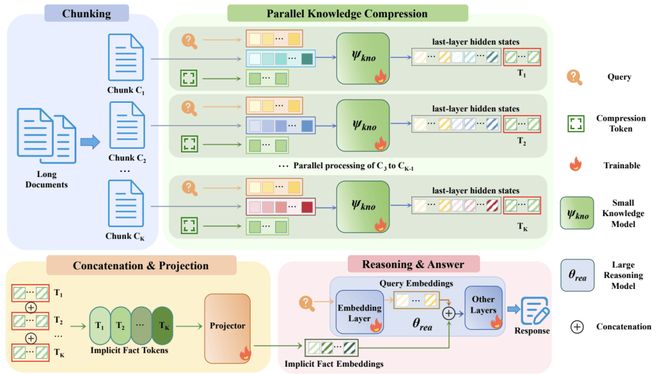

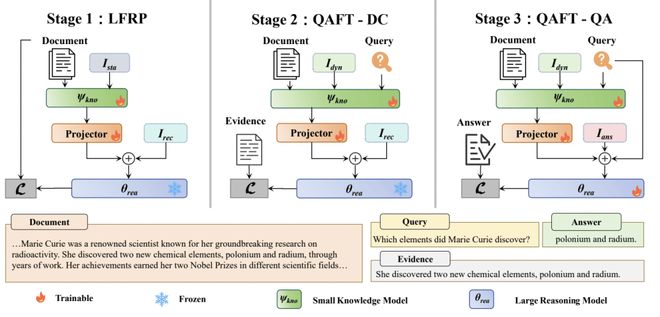

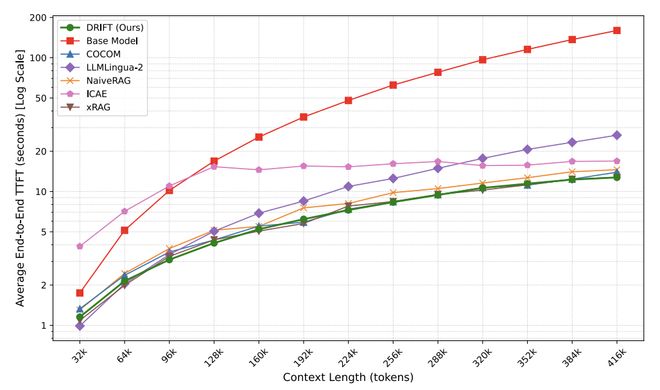

DRIFT框架的核心在于双模型设计。轻量级知识模型负责处理原始长文档,根据具体任务需求抽取高度相关的关键内容,并转化为紧凑的隐式知识表示。这种表示形式脱离自然语言文本的冗余,进入高密度隐空间,便于后续处理。推理模型则直接接收这些精炼表示,进行后续逻辑运算,无需再次接触原始材料,从而大幅降低计算负担。

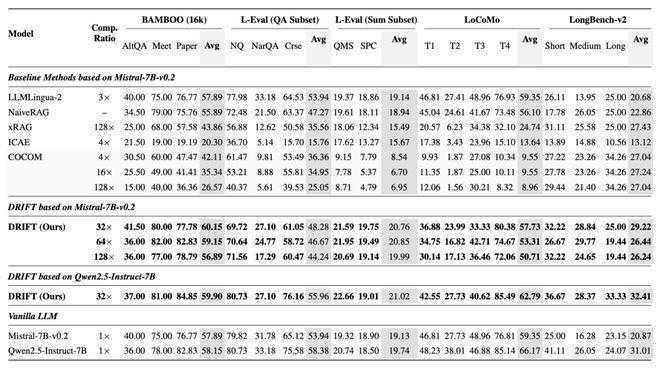

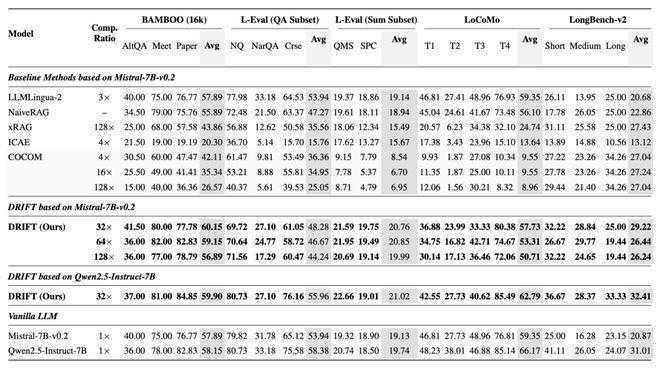

在训练阶段,框架采用逐步优化的策略。首先确保知识模型准确捕捉任务相关信息,其次训练两者间的有效协作,最后强化推理模型在精简输入上的表现。这种分阶段方式帮助模型逐步适应解耦模式,避免信息丢失或误导。实验覆盖多种长文本基准场景,包括多文档理解、长程记忆对话等,验证了该方法的实用价值。

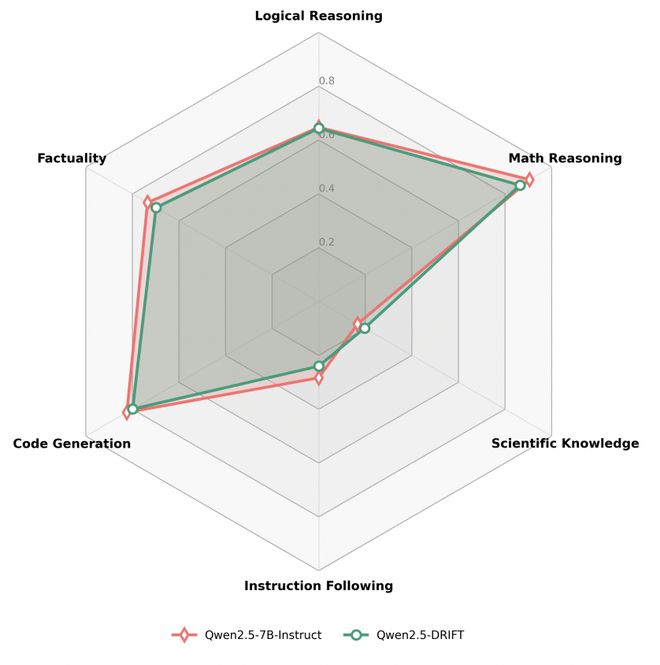

值得注意的是,即使在高压缩条件下,DRIFT仍能维持甚至改善任务表现。这表明合理分离读取与推理环节,不仅没有削弱能力,反而让系统更专注各自优势。推理模型摆脱冗长文本干扰后,逻辑链条更清晰,输出质量相应提升。

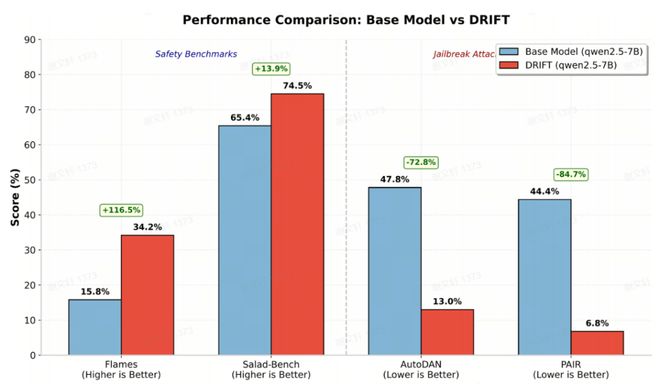

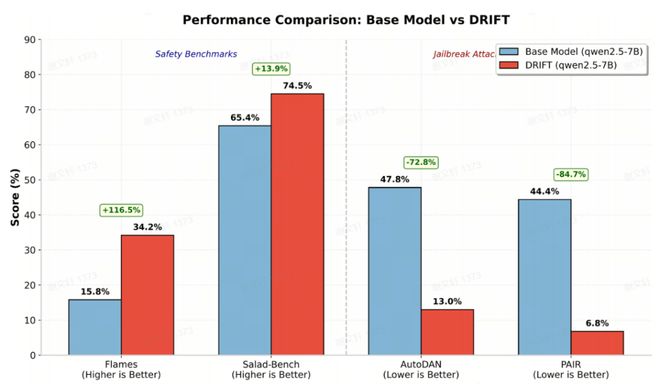

此外,该架构在安全性方面展现意外优势。由于推理模型不直接暴露于原始输入,潜在攻击提示难以直接影响决策过程。在多项安全评估中,其鲁棒性明显优于传统单一模型,且无需额外安全训练即可实现。这种天然防护机制为实际部署增添可靠性。

展望未来,这种解耦思路可扩展至更多领域。例如在科学计算中,让专用模块处理原始数据,大模型专注高级推理,有望推动人工智能在专业任务中的深入应用。DRIFT提供了一种结构性范式,强调模块化协作而非单一巨型模型的无限膨胀,为长上下文时代带来新思考方向。

总体而言,上海人工智能实验室的这项工作揭示出,高效长上下文处理的关键不在于读得更长,而在于读得更聪明、想得更纯粹。通过清晰分工,模型体系实现显著优化,展现出广阔前景。